Anthropic 部署选举安全防线

Anthropic 发布选举安全更新,承诺在美国中期选举及全球重大选举期间减少 Claude 的政治偏见,提供准确中立的政治信息。对 AI 工程师的启示:大模型厂商正主动承担平台责任,政治内容的偏见控制将成为合规标配。

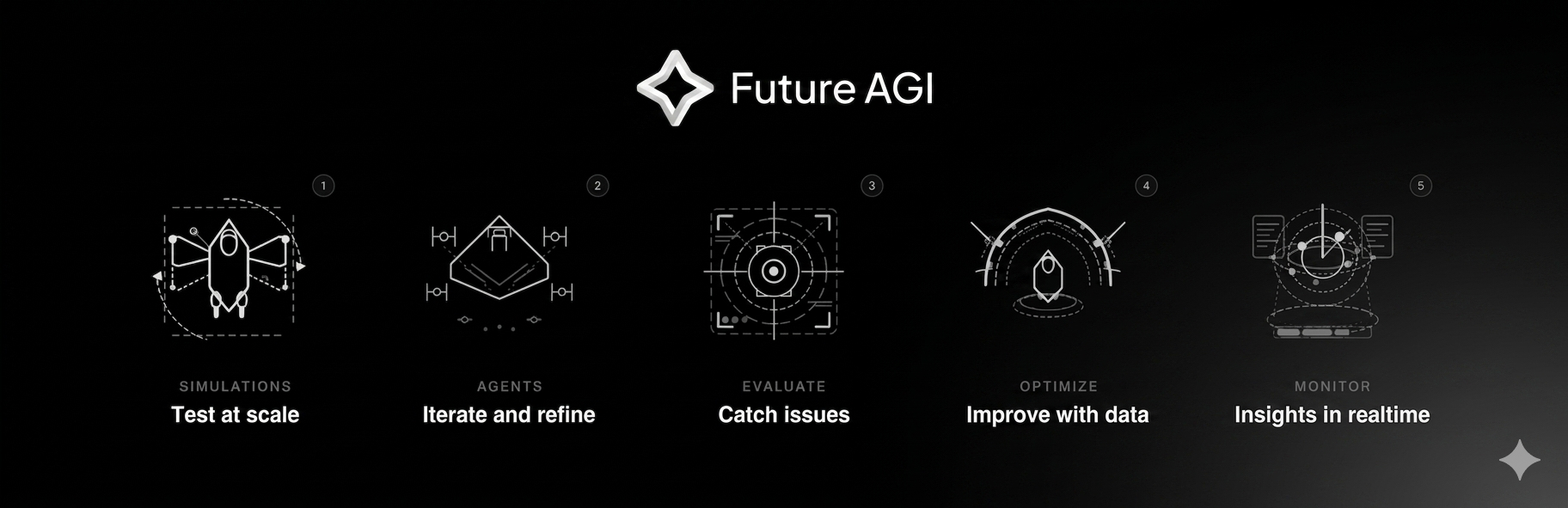

Future AGI 是一个开源的 AI Agent 全生命周期平台,集成评估、追踪、模拟、防护栏、网关和优化功能,通过单一反馈闭环实现 Agent 的自我迭代。对正在构建生产级 Agent 的工程师来说,它把目前分散在多个工具链中的环节统一到了一起,能显著降低调试和部署的复杂度。

Open-source, end-to-end platform for evaluating, observing, and improving LLM and AI agent applications. Tracing · Evals · Simulations · Datasets · Gateway · Guardrails. Self-hostable. Apache 2.0.

目前做 Agent 生产的团队普遍面临工具碎片化问题:评估用 BrainTrust 或 LangSmith,追踪另上一套,防护栏再配一个。Future AGI 的思路是把这全串成一条反馈闭环,让 Agent 的每次失败都能自动回流到评估和优化环节。这和 LangChain 的 LangGraph 或 Dify 的编排能力有重叠,但 Future AGI 更强调"自我改进"而非单纯工作流搭建,定位更接近开源版的 Galileo 或 Weights & Biases for LLM。如果你现在用 LangSmith 做追踪但苦于评估和优化脱节,可以重点看看它的 feedback loop 设计是否真能跑通。项目刚发布 nightly 版本,稳定性待验证,建议先用非核心场景试水。