OpenAI 悬赏2.5万美元找生物安全越狱

OpenAI 发起针对 GPT-5.5 的生物安全红队挑战,最高奖励 2.5 万美元寻找能绕过生物安全限制的通用越狱方法。这是首次将生物安全漏洞赏金机制化,意味着 AI 安全从内部测试转向众包攻防,安全研究者可直接参与前沿模型的防护建设。

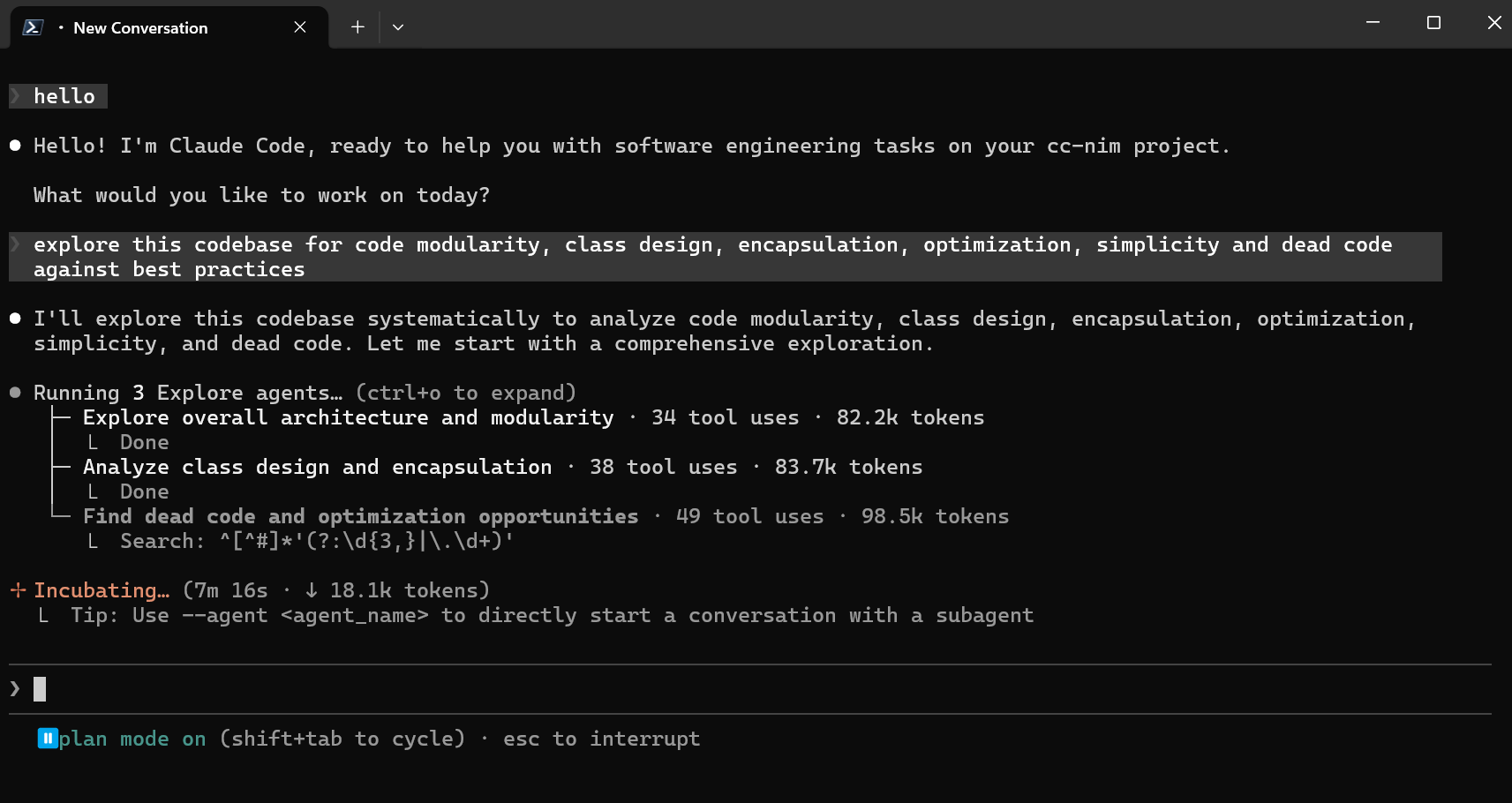

一个轻量级代理工具,将 Claude Code 的 API 调用路由到 NVIDIA NIM、OpenRouter、DeepSeek、LM Studio 等免费或本地模型端点,无需 Anthropic API key 即可使用完整功能。对想体验 Claude Code 但受限于 API 成本或地区访问的开发者,这是目前最即插即用的绕过方案。

Use claude-code for free in the terminal, VSCode extension or via discord like openclaw

Claude Code 本身不开放本地模型支持是 Anthropic 的刻意产品策略,之前开发者要么硬付 API 费用,要么用 aider 这类替代品牺牲体验。这个项目的聪明之处在于不改 Claude Code 一行代码,用代理层劫持请求,保留了官方 CLI 和 VSCode 插件的完整交互流。

跟 Continue.dev 或 Cline 这类直接替代方案不同,它适合已经用惯 Claude Code 特定工作流(如 /init、/test 命令)的团队快速降本。风险点也很明显:NVIDIA NIM 的 40 req/min 对实际项目开发可能吃紧,且代理层会增加延迟;真要做生产级替代,LM Studio 或 llama.cpp 的本地部署才是长期解,但配置门槛会陡增。

最该试的人群:正在评估是否采购 Claude Code 企业版的小团队,以及被 Anthropic API 地区限制卡住的开发者。